In vielen Fertigungsbetrieben ist Vision-KI in der Qualitätskontrolle bereits auf der Agenda. Kameras sind installiert, erste Modelle laufen im Test, doch die Ergebnisse bleiben hinter den Erwartungen zurück. Häufig liegt die Ursache nicht im Modell, sondern in den Trainingsdaten: zu wenig Varianz, unklare Labels, fehlende Edge Cases und keine saubere Überwachung der Datenqualität.

Für einen COO in der Fertigung ist genau das der kritische Punkt. Es geht nicht um ein weiteres Pilotprojekt, sondern um stabile, auditierbare Qualitätsprozesse, die sich in OEE, Ausschussquote und Reklamationsrate niederschlagen. Dieser Beitrag zeigt, wie Sie Datensätze für Vision-KI in der Qualitätskontrolle strukturiert aufbauen, wie Annotation in der Produktion organisiert werden kann und wie Sie mit Kennzahlen wie IAA und Datendrift die Kontrolle behalten.

Warum Datensätze in der QK-Vision der eigentliche Engpass sind

In der Praxis ist nicht das Modell der Engpass, sondern der Datensatz. Modelle lassen sich heute relativ schnell testen, anpassen und austauschen. Ein belastbarer Datensatz für die Qualitätskontrolle in der Fertigung entsteht dagegen nur über Wochen und Monate. Er muss die reale Varianz der Produktion abbilden, saisonale Effekte berücksichtigen und neue Fehlerbilder aufnehmen.

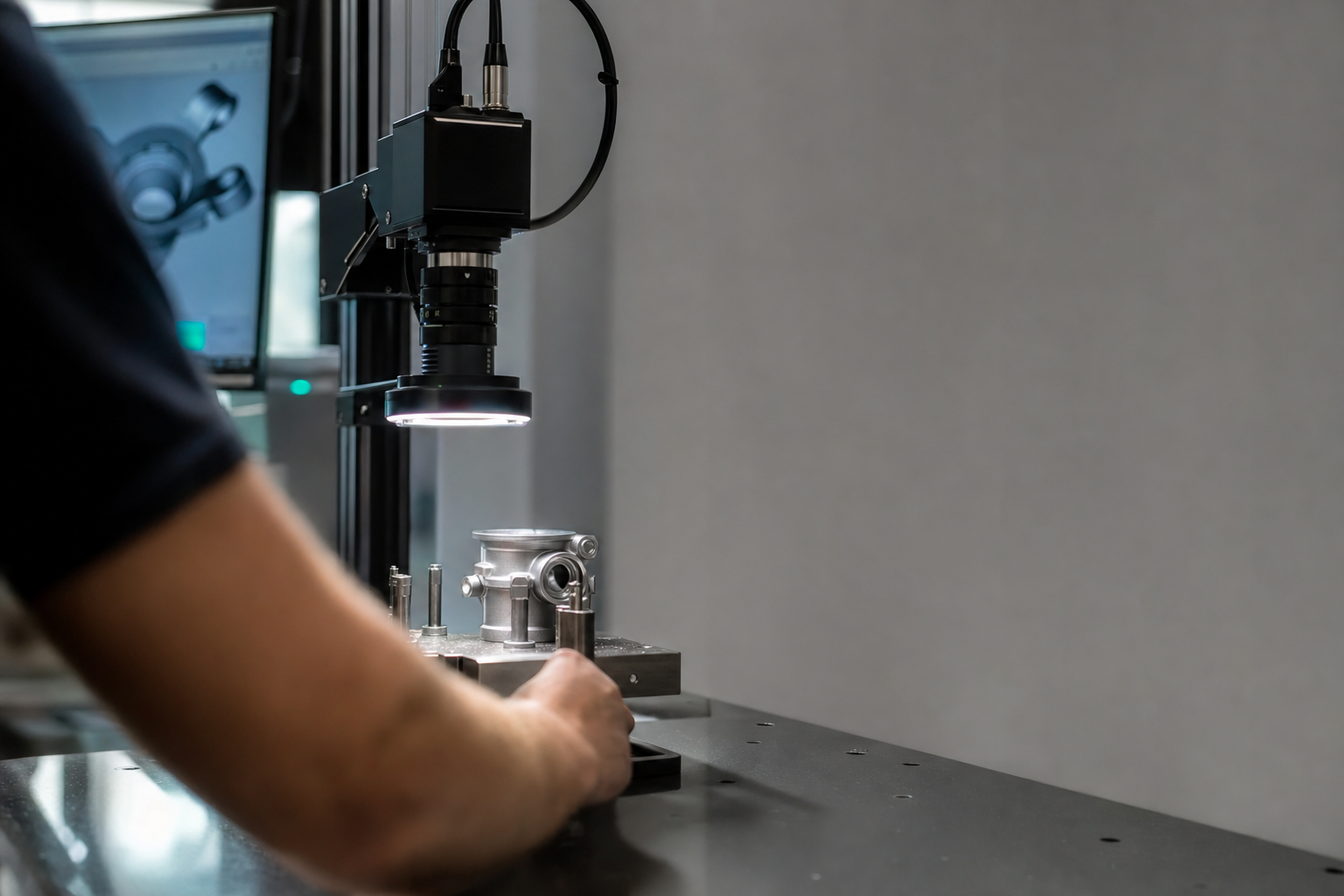

In einer typischen Fertigungslinie für Metallkomponenten sieht das so aus: Die Kameras liefern pro Schicht zehntausende Bilder. Davon eignen sich aber nur wenige Prozent als Trainingsdaten, weil viele Aufnahmen redundant oder unvollständig sind. Gleichzeitig fehlen genau die seltenen Fehler, die später zu Reklamationen führen. Aus Sicht des COO entsteht der Eindruck, dass „die KI nicht zuverlässig genug ist“, obwohl in Wahrheit der Datensatz für die Qualitätskontrolle lückenhaft ist.

Diese Wahrnehmung deckt sich mit Studien: Laut Bitkom 2025 nennen 56 Prozent der mittelständischen Unternehmen die Datenqualität als zentrales Hindernis für KI-Projekte. In der Vision-KI trifft das besonders zu, da schon kleine Unsauberkeiten in der Datensammlung oder im Datenlabeling in der Fertigung zu systematischen Fehlentscheidungen führen können.

Der Engpass liegt im Datensatz, nicht im Modell

Wer Vision-KI in der Qualitätskontrolle skalieren will, muss den Aufbau und die Pflege des Datensatzes als eigenen Prozess behandeln, mit klaren Verantwortlichkeiten, Kennzahlen und Budgets. Modell-Tuning ohne Datensatz-Strategie verpufft.

Hinzu kommt ein organisatorischer Aspekt. In vielen Werken ist unklar, wem der Datensatz eigentlich gehört. Die IT betreibt die Infrastruktur, die Qualitätssicherung definiert Fehlerklassen, die Produktion liefert Bilder, externe Dienstleister trainieren Modelle. Ohne klare Verantwortung für den gesamten KI-Datensatz in der Qualitätskontrolle entstehen Lücken, Dubletten und widersprüchliche Annotationen.

Bildmenge und Klassen-Balance: was wirklich nötig ist

Eine der häufigsten Fragen aus der Fertigung lautet: „Wie viele Bilder brauchen wir für ein gutes Vision-KI-Modell?“ Die Antwort hängt von Varianz und Klassen-Balance ab, nicht von einer abstrakten Zielzahl. Ein Datensatz mit 20.000 vielfältigen Gutteilen und 2.000 klar annotierten Fehlerbildern ist oft wertvoller als 200.000 redundante Aufnahmen ohne Struktur.

Für typische Anwendungsfälle in der visuellen Qualitätskontrolle, etwa die Erkennung von Kratzern, Poren oder Maßabweichungen, zeigt sich in Projekten, dass mehrere tausend Bilder pro relevanter Fehlerklasse ein sinnvoller Startpunkt sind. Voraussetzung ist, dass die Bilder unterschiedliche Chargen, Schichten, Maschinenzustände und Beleuchtungssituationen abdecken. Entscheidend ist, dass die Klassen-Balance im Datensatz die Realität der Produktion sinnvoll widerspiegelt, ohne die seltenen Fehler zu unterrepräsentieren.

In der Praxis bedeutet das für den KI-Datensatz in der Qualitätskontrolle: Sie überrepräsentieren Fehler bewusst im Trainingsdatensatz, um dem Modell genügend Beispiele zu geben, und gleichen dieses Ungleichgewicht später im Produktivbetrieb durch geeignete Schwellenwerte und Monitoring aus. Wer versucht, die reale Fehlerquote von vielleicht 0,5 Prozent eins zu eins im Datensatz abzubilden, riskiert ein Modell, das Fehler systematisch übersieht.

Ein Beispiel aus einem sensified-Projekt in der Medizintechnik zeigt die Größenordnung: In sechs Wochen wurden 2.400 Bilder kuratiert und annotiert, mit einem klaren Fokus auf seltene Defekte. Nach Einführung der Vision-KI in der Qualitätskontrolle sank die Defektrate messbar. Die absolute Bildzahl war überschaubar, die gezielte Auswahl und Klassen-Balance dagegen wirksam.

Für den COO ist wichtig, diese Logik in die Planung aufzunehmen. Es genügt nicht, „so viele Bilder wie möglich“ zu sammeln. Es braucht ein Konzept, welche Fehlerklassen mit welcher Priorität erfasst werden, wie viele Beispiele pro Klasse angestrebt werden und wie die Datensatz-Annotation in der Produktion organisiert wird.

| Aspekt | Typischer Zielwert / Empfehlung | Relevanz für Vision-KI in der QK |

|---|---|---|

| Bilder pro Fehlerklasse (Startpunkt) | Mehrere tausend Bilder pro relevanter Fehlerklasse | Sichert Varianz über Chargen, Schichten und Maschinenzustände |

| Fehleranteil im Trainingsdatensatz | Bewusste Überrepräsentation gegenüber realer Fehlerquote | Verhindert, dass seltene Fehler vom Modell systematisch übersehen werden |

| Inter-Annotator-Agreement (IAA) | Ausgangspunkt ca. 0,72, Ziel: schrittweise Erhöhung | Misst Konsistenz der Labels zwischen verschiedenen Annotatoren |

| Edge-Case-Abdeckung | Explizite Dokumentation und Kennzeichnung seltener Fehlerbilder | Wichtig für Reklamationsfälle und sicherheitskritische Anwendungen |

| Datendrift-Monitoring | Laufende Überwachung von Verteilungen und Fehlerklassen | Erkennt schleichende Veränderungen in Produktion und Bilddaten |

Annotation: intern, Crowd-Worker oder sensified-Kuratoren

Die beste Bildsammlung nützt wenig, wenn die Labels nicht stimmen. In der Vision-KI ist die Datensatz-Annotation in der Produktion oft der kritischste Schritt. Hier entscheidet sich, ob das Modell später zwischen „akzeptabel“ und „kritisch“ unterscheiden kann oder ob es Grauzonen falsch einschätzt.

Grundsätzlich gibt es drei Modelle für die Annotation:

- Interne Annotation durch Fachkräfte der Qualitätskontrolle

- Externe Annotation durch anonyme Crowd-Worker

- Kuratiertes Annotationsteam mit Domänenwissen, etwa in Form spezialisierter Kuratoren

Interne Annotation hat den Vorteil des tiefen Prozesswissens. Meister und erfahrene Mitarbeitende der Qualitätskontrolle kennen die relevanten Fehlerbilder und Ihre Konsequenzen. Gleichzeitig ist Ihre Zeit knapp. Wenn diese Fachkräfte nebenbei tausende Bilder labeln sollen, leidet entweder die Produktion oder die Datenqualität.

Crowd-Worker sind auf den ersten Blick kostengünstig. In der industriellen Qualitätskontrolle stoßen sie jedoch schnell an Grenzen, da sie spezifische Toleranzen, Normen und Kundenanforderungen nicht kennen. Studien wie Fraunhofer IESE 2025 berichten für industrielle QK-Annotation einen durchschnittlichen Inter-Annotator-Agreement-Wert von 0,72. Ohne Domänenwissen und saubere Schulung fällt der IAA deutlich niedriger aus, was zu inkonsistenten Labels führt.

Ein kuratiertes Annotationsteam mit Domänenwissen verbindet die Vorteile beider Welten. Bei sensified kommen in KI-Projekten für die Qualitätskontrolle spezialisierte Kuratoren zum Einsatz, die gemeinsam mit der internen Qualitätskontrolle die Label-Guidelines definieren, Edge Cases dokumentieren und regelmäßig Stichprobenprüfungen durchführen. So bleibt das Fachwissen im Unternehmen, während der Annotierungsaufwand planbar ausgelagert wird.

In einem Werk für Kunststoffteile könnte das so aussehen: Die interne Qualitätskontrolle definiert zehn zentrale Fehlerklassen mit Beispielbildern und Grenzfällen. sensified-Kuratoren übernehmen das operative Datenlabeling in der Fertigung über eine EU-gehostete Plattform, die TISAX-konform betrieben wird. Wöchentlich werden zufällig ausgewählte Annotationen gemeinsam mit der Leitung der Qualitätskontrolle geprüft, der IAA-Wert überwacht und bei Abweichungen die Richtlinien nachgeschärft.

Annotation ist ein Prozess, kein einmaliger Akt

Wer die Datensatz-Annotation in der Qualitätskontrolle als laufenden Prozess mit klaren Rollen, Schulungen und Kennzahlen organisiert, erreicht stabilere Modelle und reduziert das Risiko teurer Fehlentscheidungen im Feld.

Für Unternehmen, die diesen Prozess nicht selbst aufbauen möchten, ist das sensified-Modell KI-Result interessant. Hier liefert sensified nicht nur annotierte Bilder, sondern direkt nutzbare Resultate, etwa freigegebene oder gesperrte Teile, zu einem Pro-Stück-Preis. Der Kunde muss keinen eigenen Annotation-Workflow etablieren, sondern integriert die geprüften Ergebnisse in bestehende Systeme der Qualitätskontrolle.

Datenqualitäts-Metriken: IAA, Edge Cases und Drift im Auge behalten

Ohne Messung keine Steuerung. Das gilt auch für die Datenqualität in Vision-KI-Projekten. Drei Aspekte sind für die Qualitätskontrolle besonders relevant: Konsistenz der Annotation (IAA), Abdeckung von Edge Cases und Überwachung von Datendrift.

Der Inter-Annotator-Agreement-Wert misst, wie häufig verschiedene Annotatoren zu denselben Labels kommen. Ein IAA von 1,0 würde perfekte Übereinstimmung bedeuten, ein Wert von 0,0 reine Zufälligkeit. Fraunhofer IESE berichtet für industrielle QK-Annotation einen durchschnittlichen IAA von 0,72. Dieser Wert ist in vielen Projekten ein realistischer Ausgangspunkt, sollte aber nicht das Ziel bleiben. Mit klaren Guidelines, Schulungen und regelmäßigen Review-Runden lässt sich der IAA-Wert schrittweise erhöhen.

Edge Cases sind seltene, aber kritische Fehlerbilder. In der Fertigung können das etwa Haarrisse unter bestimmten Beleuchtungswinkeln, Materialeinschlüsse nur bei bestimmten Lieferanten oder geometrische Abweichungen bei Werkzeugwechseln sein. Ein guter KI-Datensatz für die Qualitätskontrolle dokumentiert diese Edge Cases explizit, versieht sie mit Metadaten und stellt sicher, dass Sie im Training und im Test ausreichend vertreten sind.

Datendrift beschreibt Veränderungen in den Daten über die Zeit. In der Produktion treten solche Veränderungen häufig auf, etwa durch neue Chargen, geänderte Lieferanten, Anpassungen an Maschinenparametern oder Umbauten in der Beleuchtung. Wenn sich die Bildverteilung schleichend verändert, ohne dass der Datensatz aktualisiert wird, verschlechtert sich die Modellleistung. Ein professionelles Datenqualitäts-Management für Vision-KI überwacht diese Drift kontinuierlich und stößt bei Bedarf Nachannotationen oder Re-Trainings an.

In der Praxis setzt sensified in der KI-Plattform auf automatisierte Checks für Datenqualitäts-Metriken. Die Plattform erfasst IAA-Werte, trackt die Häufigkeit von Fehlerklassen und erkennt statistische Verschiebungen in den Eingabedaten. Der COO erhält dadurch nicht nur ein Modell, sondern ein Monitoring, das frühzeitig signalisiert, wenn sich die Produktionsrealität vom Trainingsdatensatz entfernt.

Synthetische Daten: wann sie helfen und wann nicht

Synthetische Daten sind in vielen Diskussionen rund um Vision-KI ein Hoffnungsträger. Die Idee: Statt seltene Fehler mühsam zu sammeln, werden sie künstlich erzeugt, etwa durch Simulationen oder Bildtransformationen. In der Qualitätskontrolle der Fertigung kann das ein Hebel sein, aber nur unter klaren Bedingungen.

Synthetische Daten in der Qualitätskontrolle eignen sich vor allem, um Varianz in unkritischen Merkmalen zu erhöhen. Beispielsweise lassen sich Beleuchtung, Perspektive oder Hintergrund künstlich variieren, um das Modell robuster zu machen. Auch leichte geometrische Transformationen oder Rauschen können helfen, Überanpassungen zu vermeiden.

Problematisch wird es, wenn synthetische Daten reale physikalische Effekte ersetzen sollen. Ein künstlich erzeugter Riss verhält sich optisch oft anders als ein realer Riss, der durch Spannungen im Material entstanden ist. Wer ausschließlich synthetische Daten für kritische Fehlerklassen nutzt, riskiert ein Modell, das in der Simulation überzeugt, in der realen Fertigung aber nicht die erwartete Leistung zeigt.

Für den COO bedeutet das: Synthetische Daten sind ein Ergänzungswerkzeug, kein Ersatz für reale Produktionsdaten. Sie können helfen, die Klassen-Balance zu verbessern, seltene Kombinationen von Merkmalen zu erzeugen oder Testszenarien abzudecken. Die Basis muss jedoch ein sauber kuratierter, realer Datensatz aus der eigenen Qualitätskontrolle sein.

In sensified-Projekten werden synthetische Daten deshalb gezielt und transparent eingesetzt. Zunächst wird ein Kern-Datensatz aus realen Bildern aufgebaut, der die wichtigsten Fehlerklassen abdeckt. Anschließend werden synthetische Varianten erzeugt, um bestimmte Lücken zu schließen, etwa unterschiedliche Beleuchtungssituationen oder Kamerawinkel. Alle synthetischen Bilder sind klar gekennzeichnet, damit im Datensatz-Audit jederzeit nachvollziehbar bleibt, welche Anteile real und welche künstlich sind.

Datensicherheit: TISAX, Personenbild und Lieferantengeheimnis

Vision-KI in der Qualitätskontrolle berührt sensible Themen der Datensicherheit. Kameras erfassen nicht nur Teile, sondern oft auch Umgebungen, Maschinen und gelegentlich Personen. Zudem sind auf den Bildern häufig Lieferantencodes, Werkzeugnummern oder andere vertrauliche Informationen sichtbar. Für Fertiger mit Automotive-Bezug spielt TISAX eine zentrale Rolle, aber auch ohne formale Zertifizierung erwarten Kunden und Partner ein hohes Schutzniveau.

Ein COO, der Vision-KI in mehreren Werken ausrollt, muss deshalb drei Ebenen im Blick behalten:

- Technische Sicherheit der Datenspeicherung und -übertragung

- Datenschutz im Sinne der DSGVO, insbesondere bei Personenbezug

- Schutz von Geschäftsgeheimnissen, etwa Lieferantendaten und Prozessparameter

Technisch bedeutet das: EU-gehostete Speicherung, verschlüsselte Übertragung, rollenbasierte Zugriffe und Protokollierung aller Datenzugriffe. sensified betreibt die KI-Plattform TISAX-orientiert, sodass insbesondere Automotive-Zulieferer Ihre Anforderungen an Informationssicherheit adressieren können. Für andere Fertigungsbranchen ist dieses Sicherheitsniveau ein robuster Anker, um auch gegenüber Kunden und Auditoren argumentieren zu können.

Beim Datenschutz geht es vor allem um Personenbilder. In der Qualitätskontrolle ist das Risiko geringer als in klassischen Überwachungsszenarien, aber nicht null. Kameras können Mitarbeitende erfassen, etwa beim Einrichten von Prüfanlagen. Hier sind klare Richtlinien, Maskierungsverfahren und Betriebsvereinbarungen notwendig. Personen sollten entweder technisch unkenntlich gemacht oder die Bildausschnitte so gewählt werden, dass ausschließlich Teile und relevante Merkmale erfasst werden.

Schließlich spielt der Schutz von Lieferantengeheimnissen eine Rolle. Viele Datensätze enthalten Informationen über Materialchargen, Werkzeugnummern oder kundenspezifische Spezifikationen. Diese Daten dürfen nicht unkontrolliert in externe Annotation-Pools oder unsichere Cloud-Umgebungen gelangen. sensified setzt deshalb auf EU-Hosting, klare Auftragsverarbeitungsverträge und eine Plattform, bei der der Kunde die Kontrolle über seine Daten behält.

Datensatz-Audit als 4-Wochen-Festpreis-Service

Viele Fertiger stehen heute an einem ähnlichen Punkt: Es existiert bereits ein Datensatz für die Vision-KI in der Qualitätskontrolle, Modelle laufen in ersten Linien, doch die Ergebnisse sind inkonsistent. An dieser Stelle hilft kein weiterer Proof of Concept, sondern ein nüchterner Blick auf den vorhandenen Datensatz. Genau hier setzt ein Datensatz-Audit für die Qualitätskontrolle an.

Im sensified-Modell KI-Projekt wird ein solches Audit als klar umrissener 4-Wochen-Festpreis-Service angeboten. Ziel ist es, den bestehenden Datensatz systematisch zu durchleuchten, Schwachstellen zu identifizieren und konkrete Handlungsempfehlungen zu liefern. Der Ablauf gliedert sich typischerweise in vier Phasen:

- Woche 1: Datenerhebung und Kontextaufnahme (Prozess, Linien, Fehlerklassen)

- Woche 2: Quantitative Analyse (Klassen-Balance, IAA, Edge-Case-Abdeckung, Drift-Indikatoren)

- Woche 3: Qualitative Stichprobenanalyse und Interviews mit Verantwortlichen der Qualitätskontrolle

- Woche 4: Ergebnis-Workshop mit Prioritätenliste und Roadmap für Datensatz-Verbesserungen

In einem Werk für Präzisionsdrehteile könnte das so aussehen: Der bestehende Datensatz umfasst 80.000 Bilder, davon 95 Prozent Gutteile. Das Audit zeigt, dass bestimmte kritische Fehlerklassen nur mit jeweils 50 Bildern vertreten sind, die Annotation zwischen Schichten stark variiert und Edge Cases kaum dokumentiert sind. Der Inter-Annotator-Agreement-Wert liegt bei 0,68, also unter dem in Studien berichteten Durchschnitt von 0,72.

Auf Basis dieser Analyse empfiehlt sensified konkrete Maßnahmen, etwa den gezielten Aufbau zusätzlicher Bilder für kritische Fehlerklassen, die Einführung eines standardisierten Annotation-Guides und die Implementierung eines einfachen Drift-Monitorings in der bestehenden KI-Plattform. Der COO erhält damit keine abstrakte Bewertung, sondern eine priorisierte To-do-Liste mit klarem Aufwand-Nutzen-Verhältnis.

Im KI-Projekt-Modell übergibt sensified nach Abschluss des Audits sämtliche Analyseskripte, Berichte und Konfigurationen an den Kunden. Es entsteht kein Vendor-Lock-in, der Datensatz bleibt vollständig unter Kontrolle des Unternehmens. Wer anschließend eine gemanagte Infrastruktur für laufendes Monitoring und Nachannotation benötigt, kann diese über die sensified-Plattform beziehen. Wer stattdessen nur punktuell Output benötigt, etwa geprüfte Teilefreigaben, nutzt KI-Result.

Datensatz-Audit als Hebel für den ROI

Ein vierwöchiges Datensatz-Audit kostet deutlich weniger als ein weiterer gescheiterter Pilot, kann aber den entscheidenden Hebel für den ROI von Vision-KI in der Qualitätskontrolle sichtbar machen, weil es die eigentlichen Engpässe im Datensatz offenlegt.

Ein Praxisbild aus der Fertigung verdeutlicht das: In einer Werkshalle eines mittelständischen Maschinenbauers stehen drei Prüfstationen mit Kameras. Die Linien laufen im Dreischichtbetrieb, die Reklamationsquote ist stabil, aber zu hoch. Nach dem Datensatz-Audit wird klar, dass die Nachtschicht Fehler strenger annotiert als die Tagschicht, was zu widersprüchlichen Labels und instabilen Modellen führt. Mit einem einheitlichen Annotation-Guide, Schulungen und einem einfachen IAA-Monitoring sinkt die Reklamationsquote innerhalb weniger Monate messbar.

Nächste Schritte

Wenn Sie Vision-KI in Ihrer Qualitätskontrolle bereits testen oder produktiv einsetzen und der Eindruck entsteht, dass „die KI nicht zuverlässig genug ist“, lohnt sich fast immer ein Blick auf den Datensatz. Ein strukturiertes Datensatz-Audit zeigt, ob Bildmenge, Klassen-Balance, Annotation und Datenqualitäts-Metriken zu Ihrem Produktionsalltag passen.

Im Strategiegespräch mit sensified klären Sie, welche Ihrer Linien sich für ein 4-Wochen-Audit eignen, wie sich bestehende Datenquellen einbinden lassen und ob für Sie eher ein KI-Projekt mit vollständiger Code-Übergabe, eine gemanagte KI-Plattform oder ein KI-Result-Modell sinnvoll ist. Auf dieser Basis entsteht ein Fahrplan, wie Sie Ihre Trainingsdaten für Vision-KI in der Qualitätskontrolle 2026 auf ein belastbares Niveau bringen.

Wer Trainingsdaten fuer Vision-KI nicht in einer US-Cloud sammeln moechte, ordnet Souveraene AI Platform Deutschland mit EU-Hosting die EU-Hosting-Optionen IONOS, STACKIT und OVH Frankfurt in die Vision-Pipeline ein.

FAQ

- Wie viele Bilder werden für ein Vision-KI-Modell in der Qualitätskontrolle typischerweise benötigt?

- Die benötigte Bildmenge hängt stark von Varianz und Fehlerklassen ab. In vielen industriellen Szenarien sind mehrere tausend Bilder pro relevanter Fehlerklasse ein sinnvoller Startpunkt, vorausgesetzt, sie decken unterschiedliche Chargen, Schichten, Maschinenzustände und Beleuchtungssituationen ab. Wichtiger als eine abstrakte Zielzahl ist eine sinnvolle Klassen-Balance mit bewusster Überrepräsentation seltener Fehler im Trainingsdatensatz.

- Was bedeutet der Inter-Annotator-Agreement-Wert (IAA) in der Praxis?

- Der Inter-Annotator-Agreement-Wert misst, wie häufig verschiedene Annotatoren bei denselben Bildern zu denselben Labels kommen. Ein Wert von 1,0 steht für perfekte Übereinstimmung, 0,0 für Zufall. Fraunhofer IESE berichtet für industrielle QK-Annotation einen durchschnittlichen IAA von 0,72. Unternehmen sollten diesen Wert kennen, regelmäßig messen und durch klare Richtlinien, Schulungen und Review-Runden gezielt verbessern.

- Wann sind synthetische Daten in der Qualitätskontrolle sinnvoll?

- Synthetische Daten sind sinnvoll, um Varianz in unkritischen Merkmalen wie Beleuchtung, Perspektive oder Hintergrund zu erhöhen und seltene Kombinationen von Merkmalen abzudecken. Für kritische Fehlerklassen sollten synthetische Daten nur ergänzend eingesetzt werden, da künstlich erzeugte Defekte reale physikalische Effekte häufig nicht vollständig abbilden. Die Basis sollte immer ein kuratierter, realer Produktionsdatensatz sein.

- Wie lässt sich die Datensatz-Annotation in der Produktion effizient organisieren?

- Effiziente Annotation in der Produktion basiert auf klaren Rollen, einem einheitlichen Label-Guideline-Dokument und einem geeigneten Tool. Häufig definieren Fachkräfte der Qualitätskontrolle die Fehlerklassen und Grenzfälle, während ein spezialisiertes Kuratorenteam das operative Labeling übernimmt. Regelmäßige Stichprobenprüfungen und die Überwachung des IAA-Wertes sichern die Qualität der Labels ab und machen den Aufwand planbar.

- Was umfasst ein Datensatz-Audit für Vision-KI in der Qualitätskontrolle typischerweise?

- Ein Datensatz-Audit umfasst die strukturierte Analyse des bestehenden Bildbestands, der Klassen-Balance, der Annotation-Qualität und der Abdeckung von Edge Cases. Hinzu kommen Interviews mit Verantwortlichen der Qualitätskontrolle und eine Bewertung möglicher Datendrift. Ergebnis ist ein Bericht mit konkreten Handlungsempfehlungen, etwa zu zusätzlichen Bildsammlungen, Anpassungen der Annotation oder dem Aufbau eines Monitorings.

- Wie wird Datensicherheit bei Vision-KI-Projekten in der Fertigung gewährleistet?

- Datensicherheit basiert auf EU-gehosteter Speicherung, verschlüsselter Übertragung, rollenbasierten Zugriffsrechten und klaren Auftragsverarbeitungsverträgen. In der Qualitätskontrolle kommen zusätzlich Maßnahmen zur Maskierung von Personenbildern und zum Schutz von Lieferantendaten hinzu. Für Automotive-nahe Unternehmen ist eine an TISAX-Anforderungen orientierte Ausgestaltung der Plattform ein wichtiger Baustein, um Erwartungen von Kunden und Auditoren zu erfüllen.

Wählen Sie bitte Ihren Wunschtermin direkt im Kalender aus.

Weitere Artikel

- KI-Beratung | Bremen

KI-Beratung Bremen: Audit-feste KI für Aerospace, Maritime und Automotive

KI-Beratung in Bremen für Aerospace-Zulieferer, Maritime-Mittelstand und Mercedes-Tier-1: EU-Hosting, EN-9100-taugliche Dokumentation, klare Förderwege.

Weiterlesen →

- KI-Beratung | Leipzig

KI-Beratung Leipzig: Förderfähig pilotieren, sicher skalieren im Mitteldeutschen Drehkreuz

KI-Beratung Leipzig für Logistik-Hub, Energieerzeuger im Strukturwandel und Medien-Mittelstand. Wir machen KI-Projekte förderfähig, DSGVO-konform und schnell pilotierbar.

Weiterlesen →

- KI-Beratung | Köln

KI-Beratung Köln: Medien, Versicherung und Industrie mit Substanz skalieren

sensified.ai begleitet Kölner Medienhäuser, Versicherungs-Konzerne und Industrieunternehmen bei KI-Projekten mit EU-Hosting, deutschen Verträgen und messbarem Business-Impact.

Weiterlesen →

- KI-Beratung | Düsseldorf

KI-Beratung Düsseldorf: GenAI für Agenturen, Industrie und Wirtschaftsprüfung

sensified.ai begleitet Düsseldorfer Agenturen, Mode-Marken, Industrie- und Beratungshäuser bei der Einführung produktiver KI, mit EU-Hosting, AVV und klarem ROI-Fokus.

Weiterlesen →

- KI-Beratung | Berlin

KI-Beratung Berlin: Audit-feste KI für Scaleups, Behörden und Charité-Umfeld

KI-Beratung in Berlin für Scaleups, Bundesbehörden und das Charité-Umfeld. sensified.ai liefert DSGVO-konforme KI mit EU-Hosting, AVV und Audit-Trail, schnell live, prüfbar dokumentiert.

Weiterlesen →

- KI-Beratung | Dresden

KI-Beratung Dresden: Halbleiter, Mikroelektronik und Mittelstand produktiv machen

sensified.ai bringt KI-Beratung nach Dresden, pragmatisch, EU-gehostet und passgenau für Halbleiter-Fabs, Mikroelektronik-Mittelstand und Software-Startups im Silicon Saxony.

Weiterlesen →