AI-native Plattformbasis

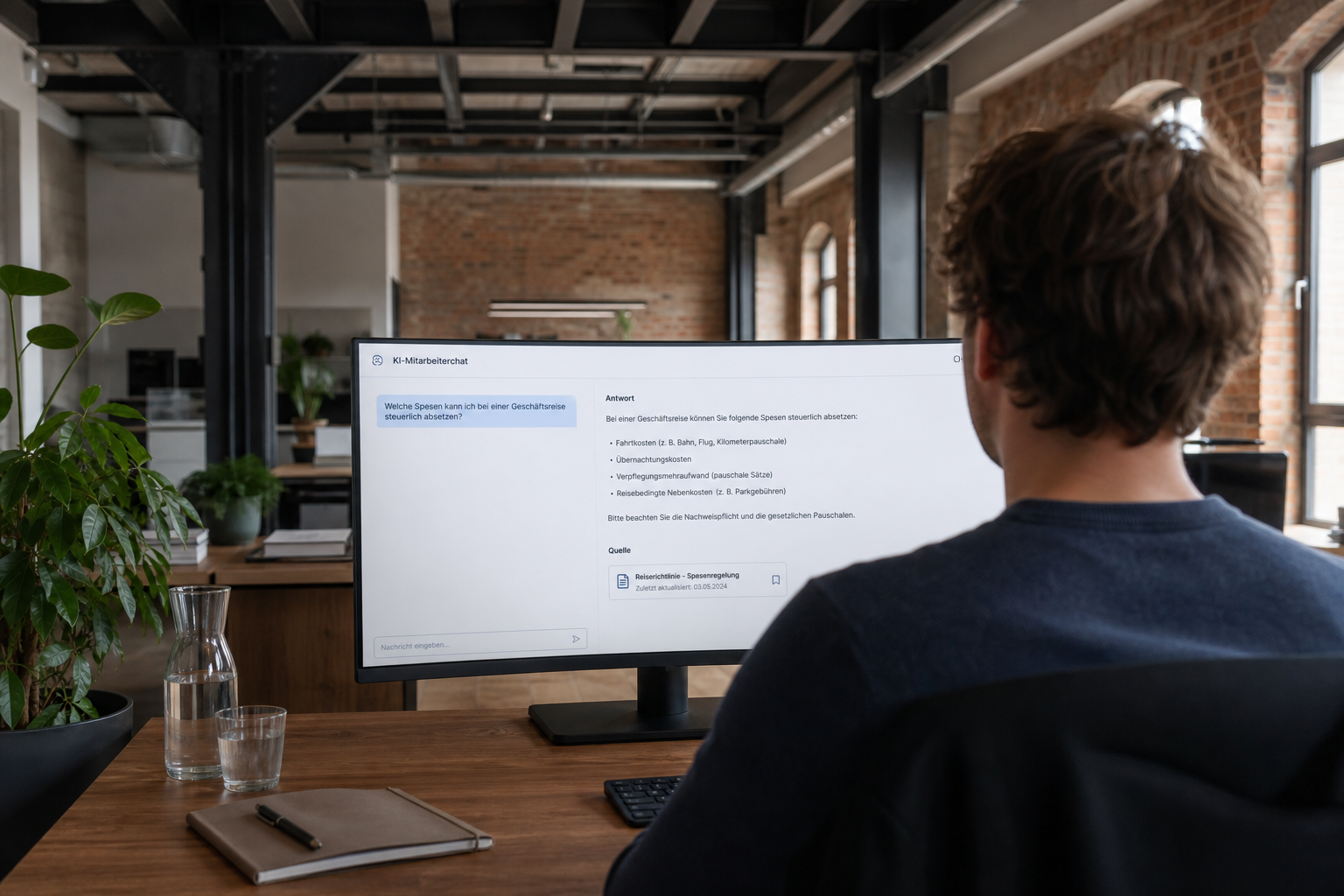

KI-Mitarbeiterchat: Internes Wissensmanagement für den Mittelstand

Kostenlose Wissens-Standortbestimmung für CIOs im Mittelstand: Wo liegt Ihr Wissen, wo versickert Zeit, was amortisiert sich?

1,8 h/Tag

verlorene Suchzeit pro Mitarbeiter

60-90 %

Standardanfragen automatisierbar

6-14 Mon

typische Amortisationsdauer

EU-Hosting

DSGVO- und KRITIS-konform

ISO 27001

zertifizierte Informationssicherheit

Das Problem

Wo internes Wissen im Mittelstand heute versickert

Mitarbeitende verbringen täglich bis zu 1,8 Stunden mit der Suche nach internen Informationen in SharePoint, Netzlaufwerken, Wikis und E-Mail-Archiven. Führungskräfte und Teams verlieren rund 25 Prozent ihrer Arbeitszeit durch Informationssuche statt Wertschöpfung – bei einem 40-Stunden-Vertrag sind das zehn Stunden pro Woche. Das Wissen ist vorhanden, aber nicht auffindbar.

Wissen nicht auffindbar

Mitarbeitende suchen täglich bis zu 1,8 Stunden in SharePoint, Netzlaufwerken und E-Mails – Wissen ist da, aber nicht dialogfähig.

Renteneintritt frisst Know-how

Bis zu 30 Prozent der Fachkräfte gehen in fünf Jahren in Rente – besonders im Maschinenbau bleibt ihr Erfahrungswissen undokumentiert.

Cloud-LLM-Risiko

Generische Cloud-Chatbots verletzen DSGVO und KRITIS, wenn Versicherungs- oder Stadtwerke-Daten an externe Anbieter abfließen.

Halluzinationen ohne Beleg

Generische KI-Chats liefern plausible, aber falsche Antworten zu Richtlinien – ohne Zitatpflicht verlieren Fachbereiche das Vertrauen.

Plattform-Architektur

6 Ebenen. Ein System.

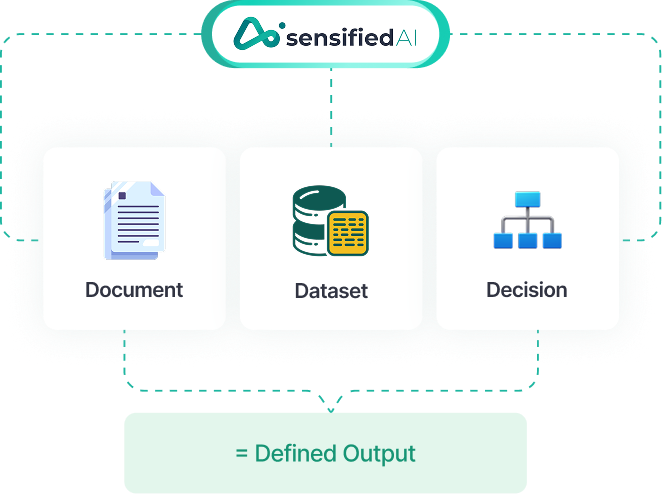

sensified ai-os ist kein einzelnes Tool, sondern eine Plattformbasis aus aufeinander abgestimmten Shared Planes. Jede Ebene löst einen konkreten Bedarf.

Was fehlt, ist kein weiteres Tool. Was fehlt, ist eine gemeinsame Betriebsbasis, die Identität, Wissen, Prozesse, Integrationen und KI-Steuerung in einer kontrollierten Architektur verbindet.

Identity Plane

SSO, Rollen, Tenant-Trennung, sichere Session-Übergabe. Die Basis für alles.

- SSO Integration

- Roles & Rights

- Audit logs

Policy & Approval Plane

Freigabelogik, Guardrails für kritische Aktionen, Eskalationsregeln. Compliance by Design.

- SSO Integration

- Roles & Rights

- Audit logs

Audit & Evidence Plane

Nachvollziehbare Entscheidungen, Ausführungsnachweise, revisionssichere Protokolle.

- SSO Integration

- Roles & Rights

- Audit logs

Connector & MCP Plane

50+ Connectoren, einheitliche Tool-Oberfläche, API-/Webhook-/Batch-Integration.

- SSO Integration

- Roles & Rights

- Audit logs

AI Gateway Plane

Kontrolliertes Modellrouting, Provider-Steuerung, Policy-nahe KI-Nutzung.

- SSO Integration

- Roles & Rights

- Audit logs

Knowledge & RAG Plane

Dokumentenintegration, semantische Suche, Master Share als persistente Wissensbasis.

- SSO Integration

- Roles & Rights

- Audit logs

Vergleich

Klassische Intranet-Suche vs. RAG-Mitarbeiterchat

Kriterium

Antwortqualität

Gescannte PDFs und Handbücher

Voice-Zugriff

Berechtigungskonzept

DSGVO und KRITIS

Halluzinationsschutz

Self-Service für HR und IT

ROI-Messbarkeit

Klassische Enterprise-Suche

Liefert Trefferlisten mit Links - Nutzer muss PDF selbst lesen und widersprüchliche Versionen abgleichen.

Findet Inhalte aus Bild-PDFs und >20.000-Seiten-Handbüchern nicht oder nur oberflächlich per Dateiname.

Keine sprachfähige Suche - Servicetechniker und Werker müssen tippen, oft mit Handschuhen unpraktikabel.

Oft flache Indizes ohne feingranulare Rechtevererbung - Nutzer sehen potenziell fremde Ordner.

Cloud-Dienste mit US-Hosting gefährden DSGVO-Konformität - besonders in Versicherung und Stadtwerken.

Keine Zitatpflicht - generative Layer erzeugen plausibel klingende, aber falsche Prozessantworten.

HR und IT beantworten Standardfragen zu Urlaub, Reisekosten und Passwort mehrfach täglich manuell.

Keine Baseline, kein KPI-Framework - Budgetfreigaben scheitern bei CIO und CFO an fehlendem Business Case.

sensified RAG-Wissenschat

Liefert eine konkrete Antwort in natürlicher Sprache mit direktem Zitat und Link zum Originaldokument.

OCR-Pipeline erschließt gescannte Dokumente und technische Handbücher vollständig textbasiert und versioniert.

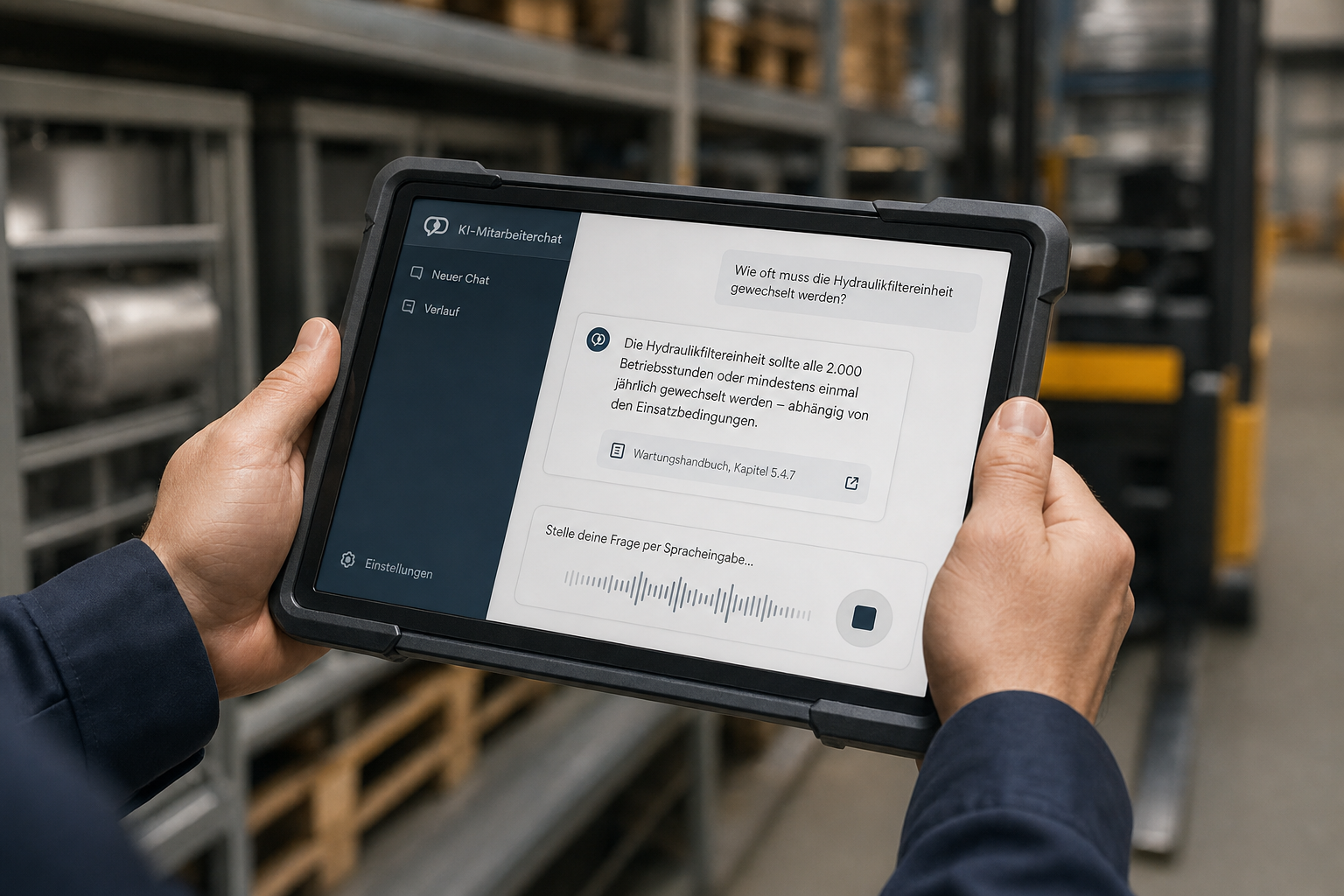

Voice-Interface für Werkstatt und Außendienst - geräuschrobust, mit Textfallback bei schlechter Akustik.

Erbt ACLs aus SharePoint, Drive und Confluence auf Dokumentebene und filtert Retrieval zur Laufzeit.

EU-Hosting oder On-Premises, AV-Verträge nach Art. 28 DSGVO, KRITIS- und VAIT-taugliche Architektur.

Zitatpflicht erzwungen: Antworten ohne Fundstelle werden geblockt, Unsicherheit wird markiert.

Automatisiert 60 bis 90 Prozent der Standardanfragen und reduziert Tickets an HR und IT um rund 50 Prozent.

Belastbare KPIs vor Rollout: Suchzeit, Ticketvolumen, Amortisation typischerweise in sechs bis 14 Monaten.

Konfiguration

Definieren Sie Ihren individuellen Arbeitsraum.

Jedes Unternehmen hat andere Prozesse, andere Systeme, andere Regeln. sensified ai-os zwingt Sie nicht in eine starre Oberfläche. Stattdessen bauen Sie Ihren sicheren Wissenszugang für Chat und Recherche auf. Welche Quellen sind angebunden, welche Freigabelogik gilt und wie schnell erhalten Teams verlässliche Antworten?

Die Plattform liefert die Shared Planes. Sie liefern die Domäne. Das Ergebnis ist kein generisches Tool, sondern Ihr AI-natives Betriebssystem.

So funktioniert es

Was ein KI-Mitarbeiterchat konkret leistet

Ein KI-Mitarbeiterchat ist ein dialogfähiger Assistent, der internes Wissen aus SharePoint, Confluence, Netzlaufwerken und Fachsystemen über Retrieval-Augmented-Generation zugänglich macht. Nutzer fragen in natürlicher Sprache, das System sucht in indizierten Quellen, erzeugt eine Antwort und belegt sie mit Fundstellen. Im Unterschied zu klassischer Enterprise Search entstehen echte Antworten, keine Trefferlisten.

1

Wissens-Standortbestimmung

Quellenlandschaft, OCR-Reife und Rechtestruktur sauber vermessen

- Inventur aller Wissensquellen inkl. Netzlaufwerke und Handbücher

- OCR-Analyse gescannter PDFs und technischer Dokumentationen

- Rechtematrix aus SharePoint, Drive und Confluence extrahieren

- Drei priorisierte Use Cases mit ROI-Schätzung definieren

2

Referenzarchitektur

RAG-Architektur nach DSGVO, BSI-Grundschutz und ISO 27001 entwerfen

- EU-Hosting oder On-Premises-Variante je nach Branche festlegen

- Rechtevererbung und Datenraum-Trennung als Architektur-Prinzip

- Zitatpflicht, Guardrails und Eskalationspfade definieren

- Voice-Interface für mobile Szenarien einplanen

3

Kontrollierter Pilot

Ein Fachbereich, klare KPIs, acht bis zwölf Wochen Laufzeit

- Indexierung priorisierter Quellen mit sauberer OCR-Pipeline

- Messung von Suchzeit, Ticketvolumen und Antwortqualität

- Wöchentliche Feedbackrunden mit Fachbereich und Betriebsrat

- Go-/No-Go-Entscheidung nach belastbarer Datengrundlage

4

Skalierung und Betrieb

Unternehmensweiter Rollout mit Governance und Betriebsmodell

- Stufenweise Anbindung weiterer Quellen und Fachbereiche

- Schulung von Content-Ownern für Wissenspflege und Kuratierung

- Kontinuierliches Monitoring von Qualität und Nutzungsgrad

- Quartalsweises Audit von Rechten, Logs und Antwortbelegen

FAQ

Häufig gestellte Fragen.

Wie funktioniert ein RAG-Chatbot für internes Wissen konkret?

Ein RAG-Chatbot kombiniert zwei Schritte: Zuerst durchsucht ein Retrieval-Modul Ihre indizierten Quellen – SharePoint, Confluence, Netzlaufwerke, gescannte PDFs – und wählt die relevantesten Textpassagen aus. Anschließend erzeugt ein Sprachmodell eine Antwort, die ausschließlich auf diesen Passagen basiert, und verlinkt die Originaldokumente. Der Clou ist die Zitatpflicht: Findet das Retrieval keine passende Fundstelle, wird die Antwort geblockt oder Unsicherheit markiert. Damit sinkt das Halluzinationsrisiko deutlich, und Fachbereiche sowie Compliance können jede Antwort nachvollziehen.

Was kostet ein KI-Mitarbeiterchat im Mittelstand?

Die Gesamtkosten setzen sich aus einmaliger Implementierung, laufenden Infrastrukturkosten und Lizenzen für das Sprachmodell zusammen. Für einen typischen Mittelständler mit 200 bis 2.000 Mitarbeitern liegt der Rahmen im niedrigen bis mittleren sechsstelligen Bereich pro Jahr, inklusive Indexierung, Hosting und Wartung. Entscheidend ist nicht der Listenpreis, sondern die Amortisationsdauer: Bei 50 täglichen Support-Anfragen und sechs Euro Einsparung je Interaktion amortisiert sich ein Projekt im Maschinenbau typischerweise innerhalb von sechs bis 14 Monaten. Wir erstellen vor jedem Pilot einen Business Case mit Ihren echten Mengen- und Kostenstrukturen.

Wie sichere ich Berechtigungen in einem KI-Wissensassistenten?

Berechtigungen sind das kritischste Thema bei Wissensassistenten und müssen vor dem ersten Dokument indiziert werden. Wir setzen auf drei Ebenen: Erstens erbt das System bestehende ACLs aus SharePoint, Drive und Confluence auf Dokument- und Ordnerebene. Zweitens trennen wir Datenräume sauber – Hochrisiko-Inhalte wie Personalakten oder M&A-Daten werden gar nicht erst indiziert. Drittens filtern wir Retrieval-Ergebnisse zur Laufzeit gegen die Identität des fragenden Mitarbeiters. Das Ergebnis: Ein Werkstudent sieht keine Geschäftsführungs-Protokolle, und ein Sachbearbeiter keine personenbezogenen Akten anderer Abteilungen.

Wie stellt eine RAG-Wissensdatenbank DSGVO-Konformität sicher?

Eine DSGVO-konforme RAG-Wissensdatenbank läuft in deutscher oder europäischer Cloud oder On-Premises. Unternehmensdaten werden nicht zum Training externer Modelle verwendet, Auftragsverarbeitungsverträge nach Art. 28 DSGVO sind Pflicht. Wir empfehlen zusätzlich technische Schutzmaßnahmen: Verschlüsselung im Transport und at rest, getrennte Mandanten, Protokollierung aller Abfragen und regelmäßige Löschzyklen für Logs. Für Versicherungen kommen VAIT und DORA hinzu, für Stadtwerke KRITIS-Auflagen nach BSI-Gesetz. Diese Anforderungen berücksichtigen wir in der Referenzarchitektur von Beginn an.

Wie nutzen Servicetechniker Voice-Suche im Intranet?

Servicetechniker im Außendienst und Werker an der Maschine haben in der Regel keine Hand frei für Tastatureingaben. Ein sprachfähiger Mitarbeiterchat nimmt Fragen über Headset oder Tablet entgegen, wandelt sie per Speech-to-Text in Text, durchsucht die Wissensdatenbank und liefert die Antwort akustisch zurück. Typische Anwendungen: Anzugsmomente einer bestimmten Maschinengeneration, Schaltplan einer Anlage, Wartungsintervalle oder Ersatzteilnummern. Für laute Werkstattumgebungen nutzen wir geräuschrobuste Modelle und erlauben einen Fallback auf Text, wenn die akustische Qualität zu gering ist.

Wie vermeidet ein KI-Chat Halluzinationen bei internen Prozessen?

Gegen Halluzinationen hilft Retrieval-Augmented-Generation mit strikter Zitatpflicht: Jede Antwort basiert ausschließlich auf indizierten, unternehmenseigenen Quellen – nicht auf dem Weltwissen des Sprachmodells. Antworten ohne verifizierte Fundstelle werden geblockt, Unsicherheit wird transparent markiert. Zusätzlich setzen wir Guardrails für sensible Themen wie Arbeitsrecht, Vertragsfragen oder sicherheitsrelevante Wartungsanleitungen: Hier leitet der Chat zwingend an einen menschlichen Ansprechpartner weiter. So entsteht ein System, dem Fachbereich und Compliance vertrauen können – weil jede Aussage auf ein Originaldokument rückführbar ist.

Für welche Unternehmensgröße ist sensified ai-os gedacht?

Was passiert mit meinen Daten?

Strategiegespräch buchen – 60 Minuten

In 60 Minuten klären wir Ihren größten Hebel. Konkrete Architektur, kein Verkaufsgespräch.

Vertiefen Sie das Thema in der sensified-Wissensbasis

Vertiefen Sie das Thema interner Wissens-Chat mit zwei Pillar-Beiträgen aus der sensified-Wissensbasis.